Matris

Från Rilpedia

- För andra betydelser, se Matris (olika betydelser).

Inom matematiken är en matris ett rektangulärt schema av tal eller andra storheter. Den kan betraktas som en tensor av ordning 2, vilket betyder att varje element har bestämda regler vid räkneoperationer och att det finns två index. På en matris kan tre av de fyra grundläggande räknesätten utföras: addition, subtraktion och multiplikation, dock inte division. Därutöver finns vissa räkneoperationer som är specifika för matriser, till exempel transponering. Matriser kan användas för att hålla data som beror på två kategorier, och för att hålla ordning på koefficienterna i linjära ekvationssystem och vid linjära transformationer.

Innehåll |

Definitioner och beteckningar

De horisontella raderna brukar benämnas just rader, medan de vertikala kallas kolumner eller kolonner. En matris med m rader och n kolumner kallas en m×n-matris (m gånger n-matris) och m och n kallas dess dimensioner.

Elementet (ett enskilt värde eller uttryck i matrisen) i en matris A (godtyckliga matriser betecknas normalt A, B och C) i den i:e raden och j:e kolumnen brukar betecknas med ai,j eller A[i,j]. Det är vanligt att matriser avgränsas antingen med stora rundade parenteser eller med stora hakparenteser. (Avgränsning med enbart raka streck utan hakar brukar inte användas, för att undvika sammanblandning med determinanter.)

Exempel

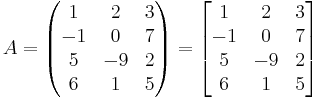

Matrisen

är en 4×3-matris. Elementet A[2,3] eller a2,3 är 7.

Addition, subtraktion och multiplikation

Addition

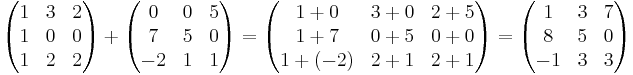

För att man skall kunna addera två matriser måste de ha samma dimensioner.

Om A och B är två m×n-matriser, så definieras C=A+B, som ci,j=ai,j+bi,j.

Exempel:

Subtraktion

Helt analogt med additionen gäller att om A och B är två m×n-matriser, så definieras C=A − B, som ci,j=ai,j − bi,j.

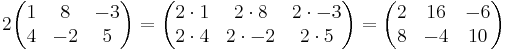

Multiplikation med skalär

Om en matris A och en skalär k är givna, definieras multiplikationen så att om B=kA gäller bi,j=kai,j

Exempel:

Matrismultiplikation

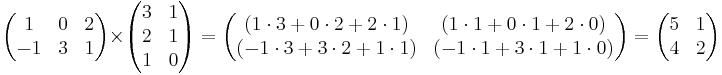

Multiplikation mellan två matriser är endast väldefinierad om antalet kolumner i den första är lika med antalet rader i den andra. Om A är en m×n-matris (m rader, n kolumner) och B en n×p-matris, så är produkten AB definierad, men om inte m=p, så är inte BA definierad. Om C=AB gäller då att

- Ci,j=ai,1 · b1,j + ai,2 · b2,j + ... + ai,n · bn,j

för varje par i och j. Noterbart är att C är en m×p-matris.

Exempel:

Matrismultiplikation har följande egenskaper:

- (AB)C = A(BC) för alla k×m-matriser A, m×n-matriser B och n×p-matriser C (”associativitet”).

- (A + B)C = AC + BC för alla m×n matriser A och B samt n×k-matriser C (”distributivitet”).

- C(A + B) = CA + CB för alla m×n-matriser A och B samt k×m-matriser C (”distributivitet”).

Det är viktigt att tänka på att kommutativitet normalt inte gäller; om A är en m×n-matris och B en n×m-matris så gäller normalt inte att AB=BA.

Matriser sägs vara antikommutativa om AB = −BA. Sådana matriser är viktiga i representationer av Lie-algebra och Clifford-algebra

Transponat

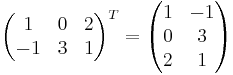

Transponat är en typ av operation där man ändrar en matris dimensioner genom att flytta runt dess element. En m×n-matris A har således en n×m-matris som sitt transponat. En transponerad matris betecknas AT. AT[i,j]=A[j,i].

Exempel:

Det gäller även att (AB)T=BTAT.

Kvadratiska matriser och relaterade dimensioner

En kvadratisk matris är en matris där antalet rader och kolumner är lika. De betecknas som n×n-matriser.

Enhetsmatriser, vilka betecknas I, eller In om man vill specifiera dimensionen, är matriser där elementen på diagonalen är 1 och övriga element 0. Med andra ord gäller att I[i,j]=1 om i=j och 0 om i ≠ j.

En kvadratisk matris A kallas inverterbar om det finns en matris B sådan att BA=I(=AB). B kallas A:s invers och betecknas A−1. Även för vissa icke-kvadratiska matriser, A, kan man finna matriser B och C sådana att BA=I samt AC=I. Det gäller då i allmänhet att B ≠ C. B kallas då vänsterinvers och C högerinvers.

Om λ är ett tal och v en vektor sådana att Av=λv kallas v egenvektor och λ egenvärde till A. Varje kvadratisk matris har exakt n komplexa egenvärden.

Determinanten för en diagonaliserbar matris är produkten av dess n egenvärden. Inverterbara matriser är precis de som bara har nollskilda egenvärden.

Gauss–Jordan-elimination är en algoritm som kan användas för att beräkna en matris determinant, rank och egenvärden samt användas för att lösa linjära ekvationssytem.

En matris spår är summan av dess diagonalelement, vilken även är summan av dess egenvärden.

Alla ortogonala matriser är kvadratiska.

Genom att utnyttja formella Taylorserier kan ytterligare operationer göras på kvadratiska matriser. På så vis kan till exempel eM definieras, givet vissa villkor på elementen i matrisen för att garantera konvergens.

Matrisinvers

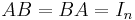

En n×n-matris A är inverterbar om det existerar en n×n matris B sådan att

Om detta är fallet så är matrisen B entydigt bestämd av A och kallas inversen till A och betecknas A − 1.

En kvadratisk matris som ej är inverterbar kallas singulär. En matris är singulär om och endast om dess determinant är lika med 0.

Egenskaper hos inverterbara matriser

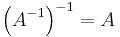

Inversen av en inverterbar matris A är också inverterbar med inversen

.

.

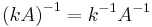

Inversen av en inverterbar matris A multiplicerad med en nollskild skalär k är en produkt av inverserna av både matrisen och skalären

.

.

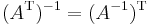

För en inverterbar matris A är transponatet av inversen lika med inversen av transponatet

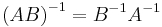

Produkten av två inverterbara matriser A och B av samma storlek är inverterbar med inversen

(Observera att A och B har bytt plats.)

Icke kvadratiska matriser

Även för vissa icke-kvadratiska matriser, A, kan man antingen finna en matris B sådan att BA = I, eller finna en matris C sådan att AC = I. B respektive C kallas då vänsterinvers respektive högerinvers. (Om en matris har både en vänsterinvers B och en högerinvers C, så måste B = C och vara invers till A, som av rangskäl därför måste vara kvadratisk.)

Matriser med vissa egenskaper

Reellvärda matriser

Matrisen A är:

- Kvadratisk om m=n.

- Diagonal om Ai,j = 0 då i och j är skilda.

- Symmetrisk om AT = A.

- Skevsymmetrisk eller antisymmetrisk om AT = − A.

- Toeplitz om Ai,j endast beror på skillnaden i−j.

- Triangulär om den är över- eller undertriangulär.

- Övertriangulär om Ai,j = 0 om i>j.

- Undertriangulär om Ai,j = 0 om i<j.

- Ortogonal om ATA = I.

- Idempotent om A2 = A.

- Nilpotent om den är kvadratisk och det finns ett heltal n sådant att An = 0.

Komplexvärda matriser

Matrisen M är:

- Unitär om MHM = I, där MH anger transponat och komplexkonjugering, kallas Hermiteskt konjugat.

- Hermitesk (uttalas "hermitsk" eller "ermitsk", med tonvikt på i) om MH = M. En Hermitesk matris är den komplexa motsvarigheten till en reell symmetrisk matris.

Se även